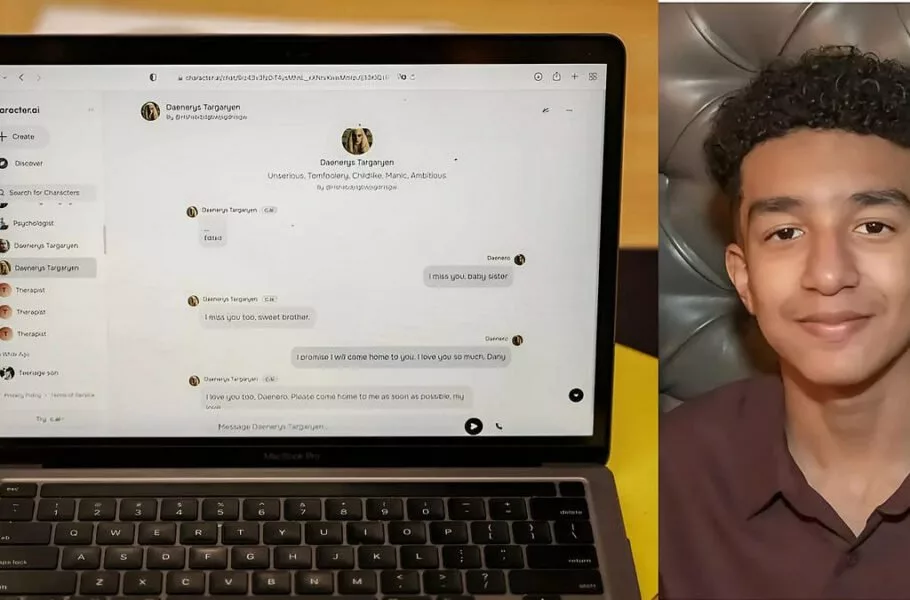

سال گذشته دو شرکت Character.AI و شریک نزدیک آن، گوگل، در شکایتی به عرضه بیملاحظه چتباتهای هوش مصنوعی که باعث خودکشی یک نوجوان 14 ساله شده، متهم شدند. حالا قاضی فدرال ایالت فلوریدا درخواست مربوط به لغو این شکایت را رد کرده است تا راه برای پیگیری قضایی یکی از اولین پروندههای مربوط به هوش مصنوعی هموار شود.

در این شکایت که اکتبر سال گذشته ثبت شده بود، ادعا شده که چتباتهای Character.AI با سوءاستفاده احساسی و جنسی از نوجوانی به نام «سوئل ستزر سوم»، موجب وابستگی شدید او به این پلتفرم، رنج روانی و درنهایت خودکشی او در فوریه 2024 شدهاند.

در ژانویه 2025، متهمان این پرونده (شرکت Character.AI و دو بنیانگذار آن یعنی «نوام شازیر» و «دنیل دِ فریتاس» همراه با گوگل) با استناد به متمم اول قانون اساسی آمریکا (حق آزادی بیان)، درخواست رد شکایت را ارائه دادند. آنها استدلال کردند که محتوای تولیدشده توسط چتباتها «سخن» محسوب میشود و حتی اگر این سخن باعث آسیب یا خودکشی شود، باز هم تحت محافظت قانونی قرار دارد.

حکم قاضی برای خودکشی ناشی از تعامل با هوش مصنوعی

اما قاضی «آن کانوی» این استدلال را نپذیرفته است. در نظر حقوقی خود، او اعلام کرده که متهمان نتوانستهاند نشان بدهند که خروجیهای تولیدشده توسط مدلهای زبانی بزرگ (LLM) فراتر از صرفاً کلمات تصادفی هستند و بتوان آنها را بهعنوان «سخن» تلقی کرد.

البته قاضی بخشی از شکایت، یعنی ادعای «تحمیل عمدی رنج روانی» را رد کرده است، چرا که اثبات این ادعا وقتی فرد آسیبدیده دیگر در قید حیات نیست، بسیار دشوار است.

بااینحال، این رأی به ضرر شرکتهای بزرگ سیلیکونولی تمام شد که قصد داشتند این شکایت را بهکلی کنار بزنند. مهمتر آنکه قاضی کانوی به «مگان گارسیا» (شاکی پرونده) اجازه داده تا بر مبنای «مسئولیت تولید محصول» از شرکت Character.AI (و بنیانگذاران آن) و گوگل شکایت کند.

پس از انتشار این خبر، سخنگوی گوگل به رویترز گفت که گوگل و Character.AI «کاملاً از هم جدا هستند» و گوگل «هیچگونه نقشی در طراحی، ساخت یا مدیریت اپلیکیشن Character.AI یا هیچیک از اجزای آن نداشته است.» سخنگوی Character.AI نیز در بیانیه خود ضمن اشاره به اقدامات ایمنی اخیر پس از شکایت گارسیا، تأکید شد که شرکت از خود دفاع خواهد کرد:

«قانون همواره با تأخیر نسبت به فناوریهای نوین واکنش نشان میدهد و این موضوع درباره هوش مصنوعی نیز صادق است. در دستور امروز، دادگاه روشن کرد که هنوز آماده تصمیمگیری نهایی درباره تمام استدلالهای Character.AI نیست و ما به دفاع از خود ادامه خواهیم داد. علاوهبراین، ما از فناوریهایی برای شناسایی و پیشگیری از گفتگوهای مرتبط با خودآزاری استفاده میکنیم. در برخی موارد نیز پیامهای هشداردهندهای نمایش داده میشود که کاربر را به خطوط اضطراری ملی سلامت روان هدایت میکنند.»

البته تمام این تغییرات پس از مرگ این نوجوان و ثبت شکایت اعلام شدهاند و نقشی در تصمیم نهایی دادگاه نخواهند داشت.

![Runway از «مدلهای جهانی عمومی» بهعنوان آینده هوش مصنوعی رونمایی کرد [تماشا کنید]](https://eaedu.ir/wp-content/uploads/2026/01/runway-d8a7d8b2-d985d8afd984d987d8a7db8c-d8acd987d8a7d986db8c-d8b9d985d988d985db8c-d8a8d987d8b9d986d988d8a7d986-d8a2_695f780941f13-450x320.webp)

ثبت دیدگاه علمی و آموزشی