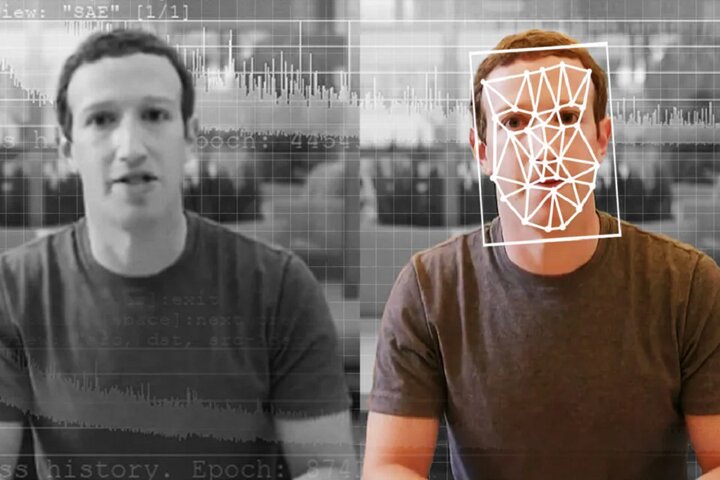

به گزارش ایسنا، در بسیاری از موقعیتهای روزمره بهویژه تماسهای ویدئویی با کیفیت پایین و محتوایی که در شبکههای اجتماعی دستبهدست میشود، میزان واقعی بودن جعلهای عمیق آنقدر بالاست که بهطور قابلاعتماد افراد غیرمتخصص را فریب میدهد. از نظر عملی، تولیدات مصنوعی برای مردم عادی و در برخی موارد حتی برای نهادها، از دادههای واقعی غیرقابلتمایز شدهاند.

به نقل از گیزمودو، این جهش فقط به کیفیت محدود نمیشود. حجم جعلهای عمیق نیز بهطور انفجاری افزایش یافته است. شرکت امنیت سایبری «دیپاسترایک» برآورد میکند که تعداد جعلهای عمیق آنلاین از حدود ۵۰۰ هزار مورد در سال ۲۰۲۳ به حدود هشت میلیون مورد در سال ۲۰۲۵ رسیده است که رشدی سالانه نزدیک به ۹۰۰ درصد است.

یک دانشمند علوم رایانه که روی جعلهای عمیق و دیگر تولیدات مصنوعی پژوهش میکند، میگوید: از نظر من، وضعیت احتمالا در سال ۲۰۲۶ بدتر هم خواهد شد، زیرا جعلهای عمیق به اجراکنندگان مصنوعی تبدیل میشوند که قادرند در لحظه به انسانها واکنش نشان دهند.

چند تحول فنی، پایههای این جهش چشمگیر را شکل دادهاند. نخست، میزان واقعی بودن ویدئوها به لطف نسل تازهای از مدلهای تولید ویدئو است که بهطور ویژه برای حفظ «انسجام زمانی» طراحی شدهاند. این مدلها قادرند ویدئوهایی را بسازند که در آنها حرکتها طبیعی و پیوستهاند، هویت افراد در طول صحنه ثابت میماند و محتوا از یک فریم به فریم بعد منطقی، هماهنگ و باورپذیر است. این مدلها اطلاعات مربوط به نمایش هویت یک فرد را از اطلاعات مربوط به حرکت جدا میکنند؛ بهگونهای که میتوان یک حرکت مشخص را به هویتهای مختلف نسبت داد یا یک هویت واحد را با انواع حرکتها نمایش داد.

در نتیجه، این مدلها چهرههایی پایدار و منسجم تولید میکنند، بدون آن سوسو زدن، اعوجاج یا تغییر شکلهای ساختاری در اطراف چشم و خط فک که زمانی بهعنوان شواهد قابلاعتماد برای شناسایی جعلهای عمیق به کار میرفت.

عبور شبیهسازی صدا از چیزی است که او آن را «آستانه غیرقابلتشخیص بودن» مینامد. اکنون چند ثانیه صدا کافی است تا یک نسخه شبیهسازی شده متقاعدکننده همراه با آهنگ گفتار طبیعی، ریتم، تاکید، احساس، مکثها و حتی صدای نفس کشیدن ایجاد شود. این توانایی همین حالا هم به کلاهبرداریهای گسترده دامن زده است. برخی خردهفروشان بزرگ گزارش میدهند که روزانه بیش از هزار تماس کلاهبرداری تولیدشده با هوش مصنوعی دریافت میکنند. نشانههای شنیداری که زمانی صدای مصنوعی را لو میدادند، تا حد زیادی از بین رفتهاند.

ابزارهای مصرفی هستند که مانع فنی را تقریبا به صفر رساندهاند. ارتقاهای هوشهای مصنوعی سورا ۲ اوپن ایآی (OpenAI Sora ۲) و وئو ۳ گوگل (Google Veo ۳)، بههمراه موجی از استارتاپها، به این معناست که تقریبا هر کسی میتواند یک ایده را توصیف کند و اجازه دهد یک مدل زبانی بزرگ مانند چت جیپیتی یا جمینای سناریوی آن را بنویسد و در عرض چند دقیقه محتوای صوتی-تصویری تولید کند. عاملهای هوش مصنوعی میتوانند کل این فرایند را خودکار کنند. توانایی تولید جعلهای عمیق منسجم و داستانمحور در مقیاس بزرگ عملا همگانی شده است.

ترکیبِ افزایش سرسامآور تعداد جعلهای عمیق با «شخصیتهایی» که تقریبا از انسانهای واقعی قابلتشخیص نیستند، چالشهای جدی برای شناسایی جعلهای عمیق ایجاد میکند، بهویژه در محیط رسانهای که توجه افراد پراکنده است و محتوا سریعتر از آن منتشر میشود که بتوان آن را راستیآزمایی کرد. پیشتر نیز آسیبهای واقعی رخ دادهاند؛ از اطلاعات نادرست گرفته تا آزار هدفمند و کلاهبرداریهای مالی که با کمک جعلهای عمیق و پیش از آنکه مردم متوجه شوند چه اتفاقی افتاده، گسترش یافتهاند.

با نگاه به آینده، مسیر سال آینده روشن است: جعلهای عمیق بهسمت تولید در لحظه حرکت میکنند؛ یعنی ساخت ویدئوهایی که بسیار نزدیک به ظرافتهای ظاهری انسان هستند و شناسایی آنها را برای سامانههای تشخیص دشوارتر میکنند. مدلهایی که محتوای زنده یا نزدیک به زنده تولید میکنند، نه کلیپهای از پیش تولید شده.

با بلوغ این قابلیتها، شکاف ادراکی میان رسانههای مصنوعی و انسانیِ واقعی همچنان کمتر خواهد شد. خط دفاعی معنادار، دیگر بر قضاوت انسان متکی نخواهد بود. در عوض، به حفاظتهای زیرساختی وابسته میشود؛ از جمله منشأ امن محتوا، مانند امضای رمزنگاریشده رسانهها و ابزارهای تولید محتوا. دیگر فقط دقیقتر نگاه کردن به پیکسلها کافی نخواهد بود.

انتهای پیام

![Runway از «مدلهای جهانی عمومی» بهعنوان آینده هوش مصنوعی رونمایی کرد [تماشا کنید]](https://eaedu.ir/wp-content/uploads/2026/01/runway-d8a7d8b2-d985d8afd984d987d8a7db8c-d8acd987d8a7d986db8c-d8b9d985d988d985db8c-d8a8d987d8b9d986d988d8a7d986-d8a2_695f780941f13-450x320.webp)

ثبت دیدگاه علمی و آموزشی